快速了解:FILM

是什么:智能视频补帧,流畅提升帧率

适合

关注 AI电影、视频 相关场景的用户;主要在 全球用户 下使用 AI 工具的用户

注意

若你期望完全离线、私有化部署且不接受任何联网服务,请优先评估企业版或自建方案。

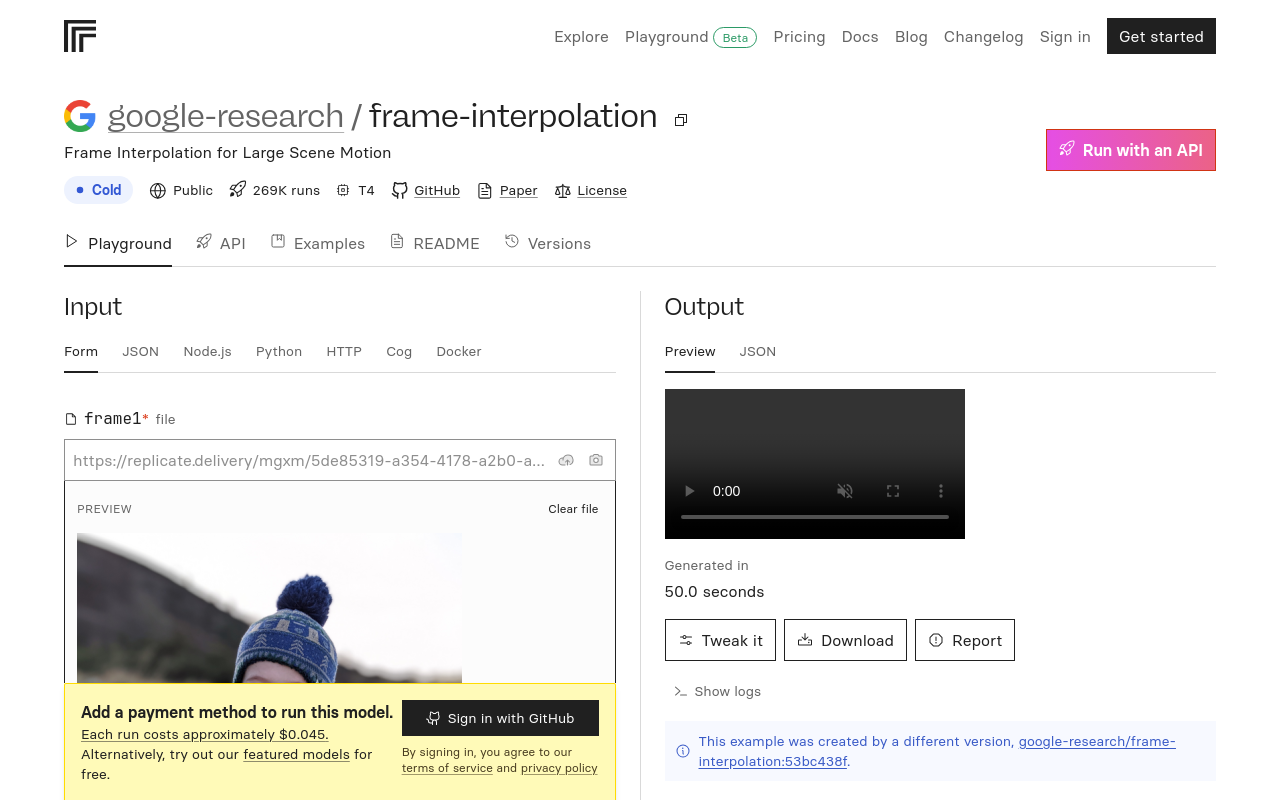

在Replicate平台上,你可以找到一个由谷歌研究团队开发的模型,专门用来解决视频卡顿的问题。它的核心任务很明确:给你两帧相邻的视频画面,它就能在中间“无中生有”,生成出过渡自然的新帧,让动作看起来丝滑流畅,画面闪烁也一并消除。

技术是如何实现的

这个模型的设计思路很直接。它不需要预先借助其他网络来分析画面里的光流或深度,自己就能搞定。通过多尺度提取特征和自适应卷积,它可以直接合成出中间帧。这对于处理物体快速移动或者画面视角大幅变化的复杂场景特别有效。

使用起来也很简单:你只需要提供两张连续的图片作为输入。然后,你可以告诉模型你想在两帧之间插入多少层过渡(最多8层),以此来控制最终视频的帧率和流畅度。

怎么用?在哪儿用?

最方便的途径就是通过Replicate平台。操作分三步:找到这个模型,上传你的两张图,设置一下插值次数(比如设为2,就能生成1张中间帧)。剩下的就交给平台背后的Nvidia T4 GPU去处理了。

如果你是开发者,可以通过API把它集成到自己的项目里。如果只是偶尔用用,直接在网页上拖拽上传文件就行,几乎没什么技术门槛。

它的长处与短板

最大的优点就是省心。你不用自己搭建深度学习环境,Replicate提供了现成的云端算力。模型本身是开源免费的,对于一般的使用量来说,成本几乎为零。而且在T4显卡上运行速度很快,能满足一些实时处理的需求。

当然,它也有局限。输入的两帧必须是紧挨着的连续画面,不能跳着帧来插值。另外,生成视频的分辨率也无法超过你原始图片的尺寸。

能用在哪些地方?

它的用武之地很广。电影和游戏制作可以用它来优化高速镜头;直播时能提升低帧率视频的观感;甚至科研人员也能用它来让动态数据图表变得更平滑。

更进一步,它可以用来修复老电影,把低帧率的经典影片变得流畅;也能用于虚拟现实(VR)内容,提高帧率以减少用户的眩晕感;在科学研究中,帮助生成高帧率的实验过程动画。