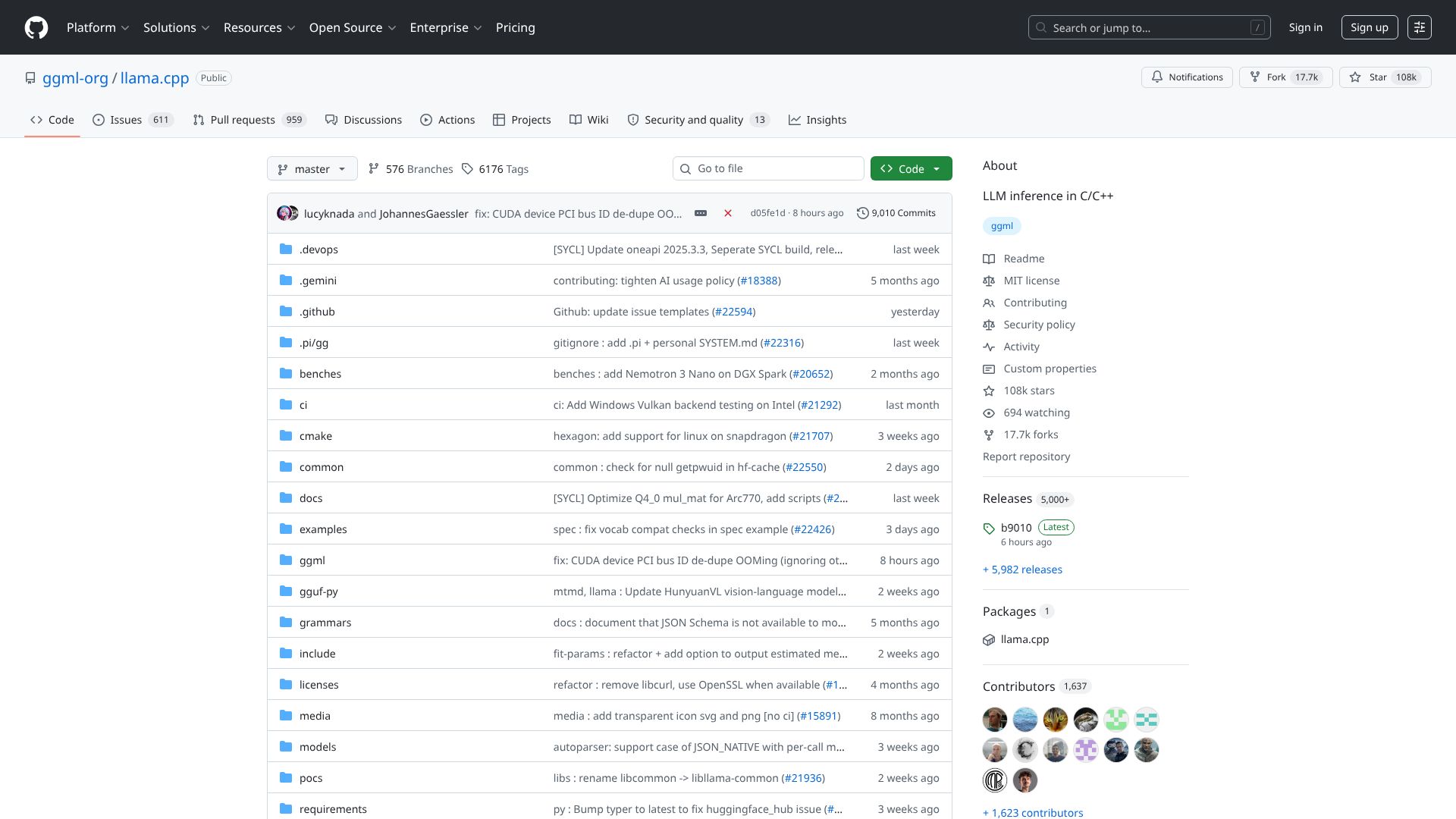

如果你还在为在消费级硬件上运行多模态大模型而发愁,这个仓库或许能让你眼前一亮。它基于 llama.cpp 的 GGUF 格式,让你可以在 CPU 或低显存 GPU 上跑起视觉语言模型,无需昂贵的 A100。对于想要本地体验 LLaVA、BakLLaVA 等模型的开发者和爱好者来说,这是个开箱即用的选择。

核心看点

– 低门槛推理:利用 llama.cpp 的量化能力,将 7B 参数的多模态模型压缩到 4-6 GB,普通笔记本也能运行。

– 原生支持多模态:不仅处理文本,还能直接接受图像输入并生成描述或回答,实现图文对话。

– 活跃社区维护:基于 MIT 许可证,近期仍有提交,Issue 和 PR 响应及时,适合二次开发或集成到自己的项目。

上手提示

推荐在 Linux 或 macOS 上使用,Windows 需配合 WSL。无需 GPU,但 16GB 以上内存能获得更好体验。无需任何 API Key,下载 GGUF 模型文件即可运行。如果你是本地 AI 应用开发者,或想离线使用多模态功能,这个仓库值得一试。

感兴趣的话,直接去 README 查看快速开始和示例,还能找到社区预制的模型权重。仓库地址:llama.cpp 多模态扩展