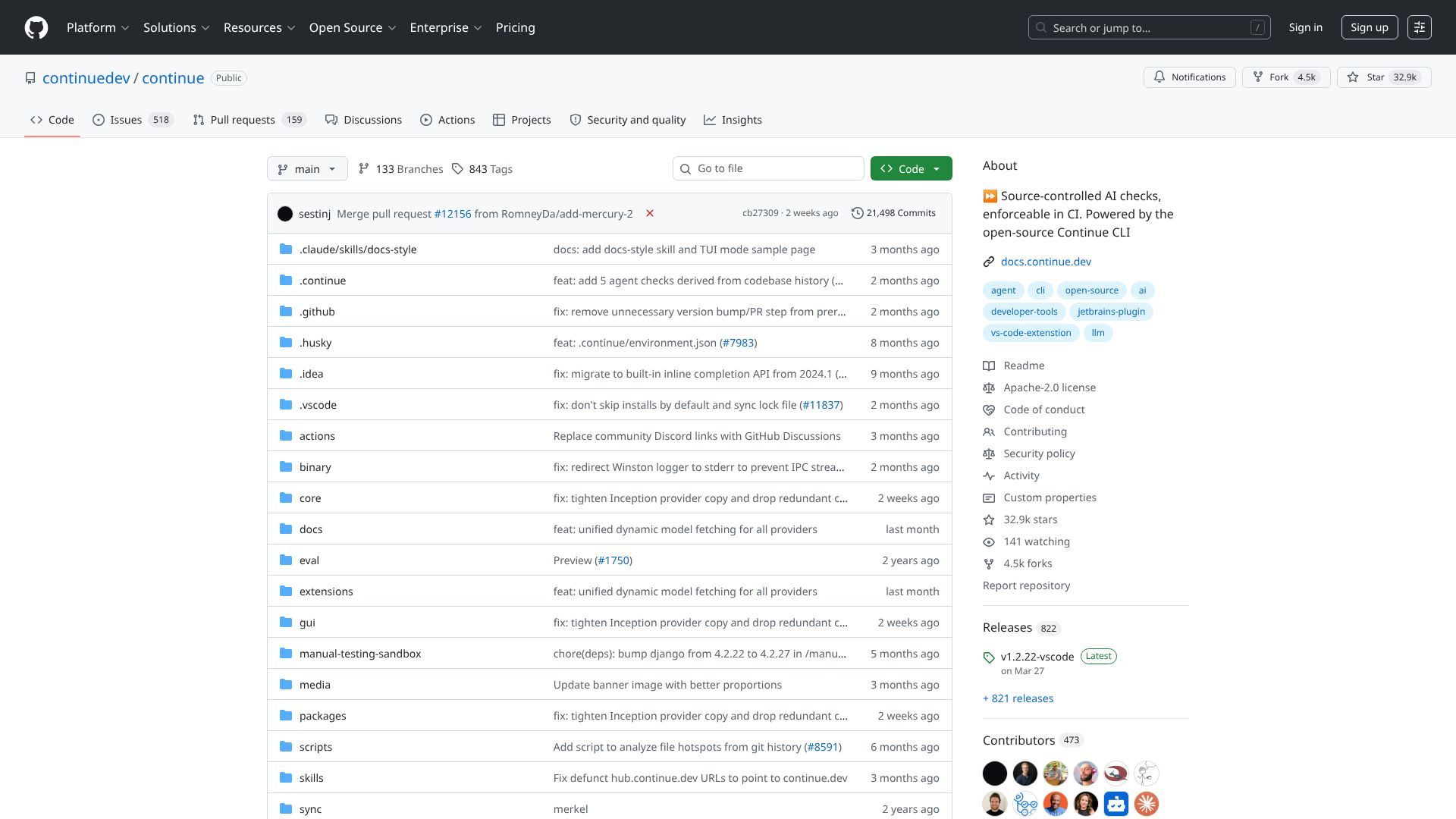

如果你既想享受 AI 编程助手的便利,又不想把代码片段上传到云端,Continue 是目前最成熟的本地方案。这个开源项目让你在 VS Code 或 JetBrains IDE 里直接接入本地推理后端(如 llama.cpp、Ollama),也能连 OpenAI、Anthropic 等云端 API——全凭你选择。项目持续活跃,MIT 许可证,社区已经积累了相当多的插件与配置示例。

核心看点

– 模型自由:支持 llama.cpp、Ollama、vLLM 等多种本地推理引擎,也兼容 OpenAI 兼容 API,切换只需改一行配置。

– 对话即上下文:选中代码后可直接提问、修改、解释,上下文自动包含相关文件,无需手动复制粘贴。

– 内置 RAG 能力:通过 @codebase 指令自动检索项目内相关代码片段,让大模型理解你的仓库结构。

适合谁

日常使用 VS Code 或 JetBrains 的开发者,尤其是对数据隐私敏感、希望离线编程或调试私有代码库的人。需要本地 GPU(或 CPU 推理)来运行模型,若使用云端 API 则需相应 Key。

从 README 的快速开始示例出发,几分钟就能搭好第一条对话。更多自定义配置、自定义 Slash 命令和上下文提供器,值得去仓库的 Docs 与 Discussions 里翻一翻。马上体验:Continue 开源编程助手