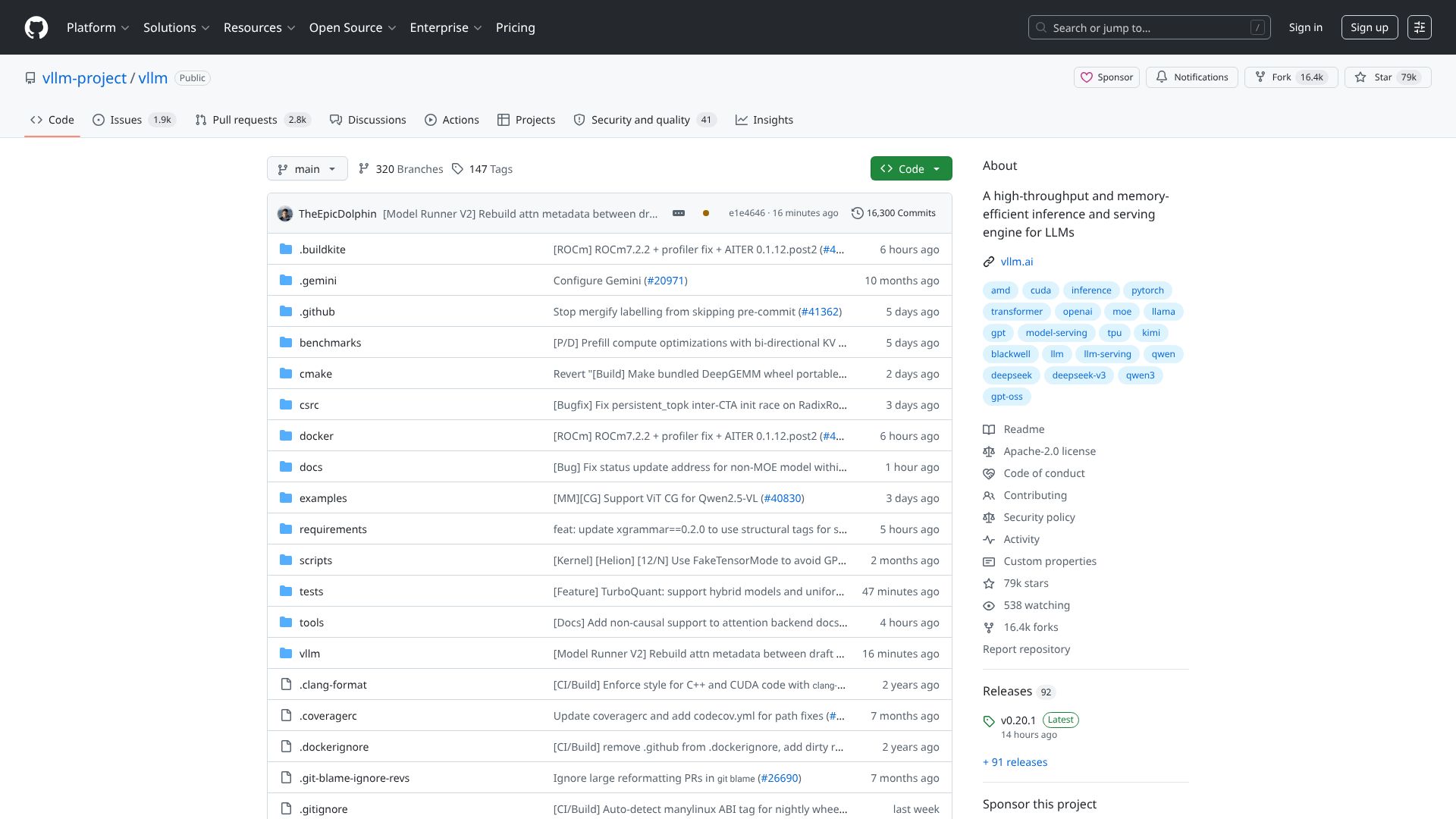

如果你正在为部署大语言模型的推理延迟和吞吐量发愁,vLLM 可能是你需要的开源利器。它利用 PagedAttention 技术高效管理显存,显著提升推理速度,特别适合那些需要自建模型服务的开发者和团队。

核心看点

– PagedAttention 显存管理:借鉴操作系统的分页机制,将 KV Cache 按块管理,减少显存碎片,支持更高并发与更长上下文。

– 高吞吐与低延迟:支持连续批处理、异步调度,实测吞吐量可达传统框架的 2~4 倍,非常适合生产环境。

– 兼容 OpenAI API:提供与 OpenAI 兼容的 RESTful API,可无缝替换或集成现有应用,支持 Hugging Face 模型权重直接加载。

适合谁

适合需要部署开源大模型(如 Llama、Mistral、Qwen 等)的开发者,要求 Python 3.8+ 和 CUDA 11.8+ 环境。无需额外 API Key,模型权重需自行下载或从 Hugging Face 加载。推荐使用 A100、V100 等显存充足的 GPU 获得最佳体验。

赶快去仓库看看 README 中的快速开始和性能调优建议,社区活跃的 Issue 和 PR 也能让你少踩坑。仓库地址:vLLM GitHub 仓库