想知道哪个AI聊天机器人更聪明?LMArena.ai给你答案。这个由加州大学伯克利分校SkyLab团队在2023年创建的开源平台,就像一个AI模型的“比武擂台”,让用户通过实际对话来给模型打分排名。

平台怎么玩

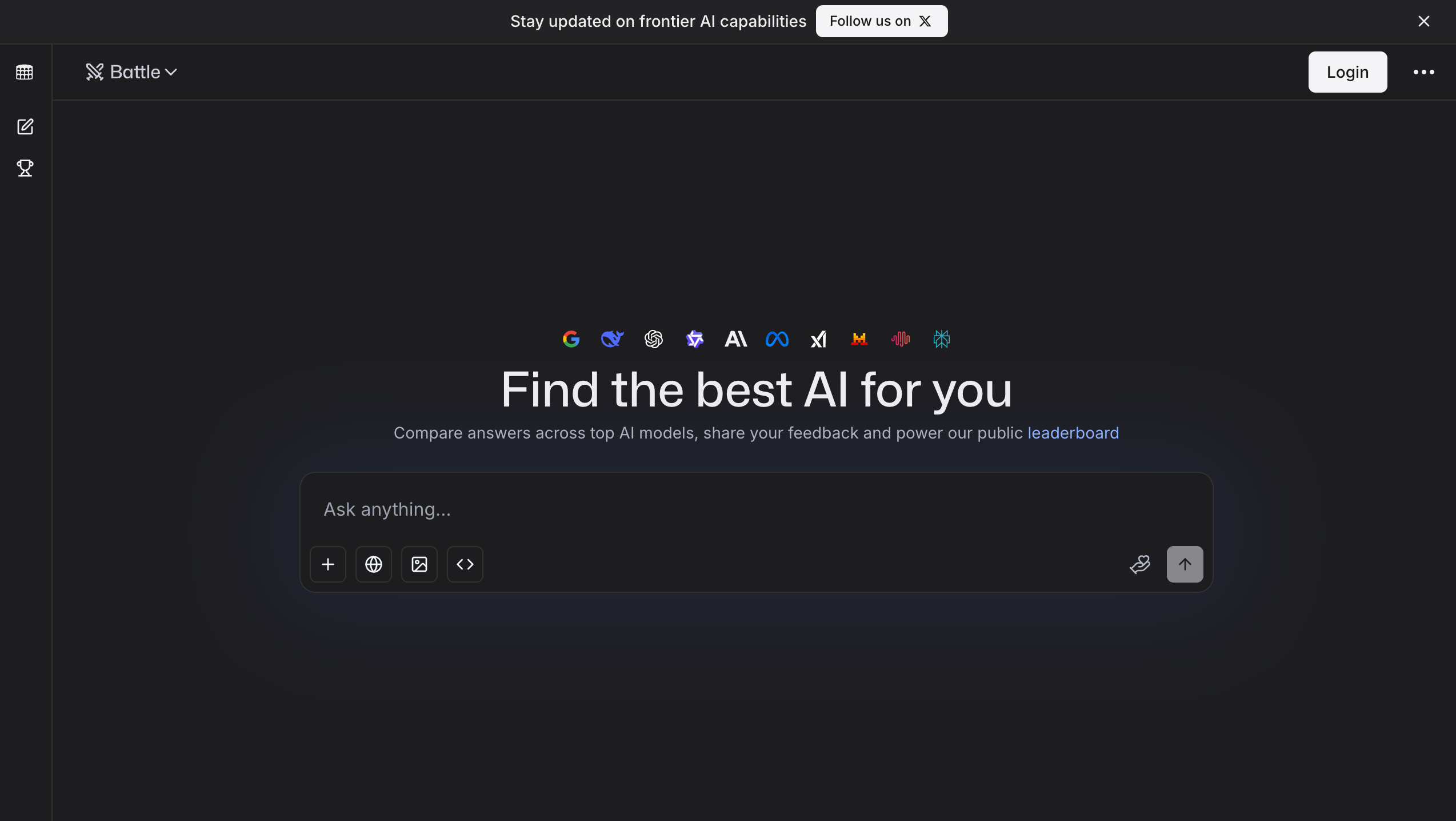

访问LMArena.ai,你会看到几种不同的玩法。

匿名对战 (Arena Battle)

最刺激的模式。你输入一个问题,系统会随机派两个匿名AI模型来回答。看完它们的答案后,你投票选出更好的那个——就像裁判给拳击手打分。投票后才会揭晓模型的名字,确保你不会因为品牌偏见而影响判断。

手动比较 (Arena)

如果你就想对比特定的两个模型,比如ChatGPT和Claude,可以用这个模式。从下拉菜单里选好对手,让它们回答同一个问题,然后仔细对比哪个回答更让你满意。

直接聊天 (Direct Chat)

想单独测试某个模型?选这个就行。一对一对话,没有对比压力,适合深度了解某个AI的能力。

新版平台还支持登录账号,保存你的聊天记录,甚至创建个人专属的排行榜。

模型评估与排行榜

你每次投票都不是白投的。平台采用国际象棋的Elo评级系统,根据胜负关系动态计算每个模型的分数,生成实时更新的排行榜。

除了人工投票,平台还有自动评估工具Arena-Hard-Auto,用GPT-4.1、Gemini-2.5这些“AI裁判”来快速测试模型在500个挑战性问题上的表现。

如果你关心编程能力,可以看看WebDev Arena——这是AI模型的编程比赛,看谁写的网页代码更好用。

为什么值得试试

LMArena目前集成了70多个模型,从OpenAI、Google、Anthropic的商业模型,到Vicuna、Llama等开源模型都有涵盖。所有功能完全免费,全球用户已经贡献了超过280万次投票,形成了庞大的真实使用数据。

研究人员可以在这里获取标准化的评估数据,开发者能通过用户反馈优化自己的模型,普通用户则能直观地了解不同AI的强弱项——比如哪个更擅长创意写作,哪个逻辑推理更强。

需要注意的地方

投票毕竟带点主观性,你的偏好可能和别人不一样。平台主要测试语言和部分编程能力,不涉及图像生成等其他AI领域。高峰期访问时,响应可能会慢一些。

想提交自己的AI模型来参赛?平台代码开源在GitHub上,欢迎贡献。你也可以通过Discord、Twitter和开发团队直接交流。

下次有人争论哪个AI更厉害时,你可以说:“上LMArena比比看就知道了。”