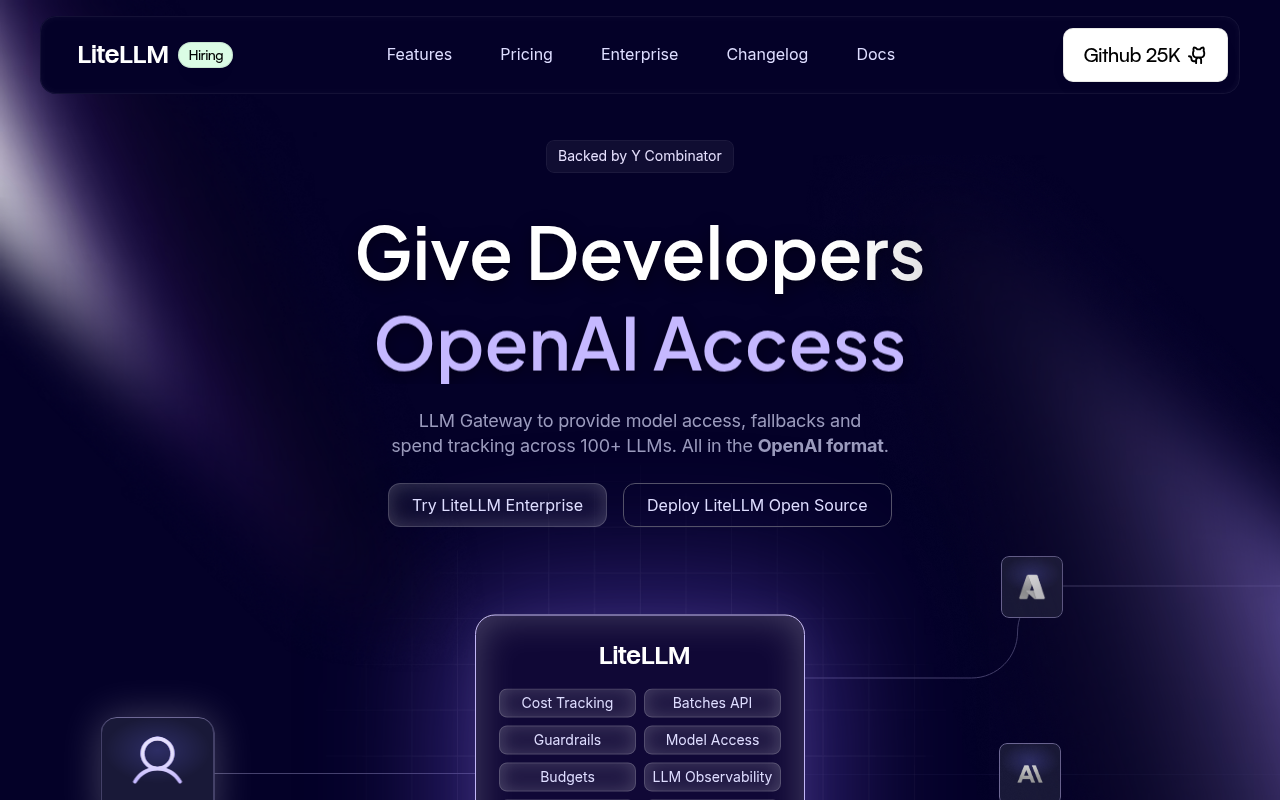

LiteLLM:你的大语言模型统一网关

如果你正在为调用不同厂商的大语言模型(LLM)而头疼,代码里塞满了各种API密钥和格式转换,那么LiteLLM可能就是你的解药。这个开源工具(官网:https://litellm.ai)本质上是一个智能代理,它把来自100多家厂商的LLM API,全都“翻译”成了OpenAI的格式。这意味着,你只需要学会一种调用方式,就能指挥上百种模型干活。

核心价值:让平台团队松口气

LiteLLM主要服务于需要为内部开发者提供LLM服务的平台团队。它的核心目标是当个靠谱的“中间商”,帮你处理所有繁琐的底层对接。Netflix的工程师说,这玩意儿每次新模型发布都能省下他们好几个小时,累计下来可能省了几个月的人力。RocketMoney的团队则喜欢它统一了日志和认证,改起需求来快多了。

主要功能:不止是翻译官

LiteLLM可不是个简单的格式转换器,它管得相当宽:

- 智能调度与容灾:主模型挂了?自动切换到备用的。请求太多?自动帮你做负载均衡。

- 成本管家:实时追踪每个团队、每个项目的LLM使用花费,还能设置预算和速率限制,防止账单爆炸。

- 全方位监控:轻松对接Langfuse等观测工具,所有请求日志还能存到S3,调试和复盘一目了然。

- 安全与合规:内置防护栏过滤有害输出,也支持将请求直接透传给底层厂商。

- 团队管理:可以给不同团队分发虚拟密钥,各自独立核算,方便内部审计和管理。

支持的模型:几乎全覆盖

从OpenAI的GPT系列、Anthropic的Claude,到Google的Gemini、AWS Bedrock上的各种模型,乃至Azure OpenAI,主流的LLM提供商基本都在它的支持列表里。你可以把它看作一个LLM世界的“万能遥控器”。

如何开始:免费开源,按需升级

LiteLLM采用开源+企业版的模式:

- 开源版:完全免费。上面提到的核心功能,比如100+模型集成、负载均衡、成本追踪、限流防护等都包含。你可以用Docker自己部署,适合个人开发者或小团队尝鲜。

- 企业版:需要联系获取报价。在开源版基础上,增加了企业级支持、SLA服务保障、JWT/单点登录认证、更完善的审计日志等特性,适合有高可用和严格合规要求的大型组织。

这个工具已经处理了超过10亿次请求,由400多位贡献者共同维护,稳定性值得信赖。无论你是想快速实验多个模型,还是需要为整个公司搭建统一的AI能力平台,LiteLLM都提供了一个坚实的起点。