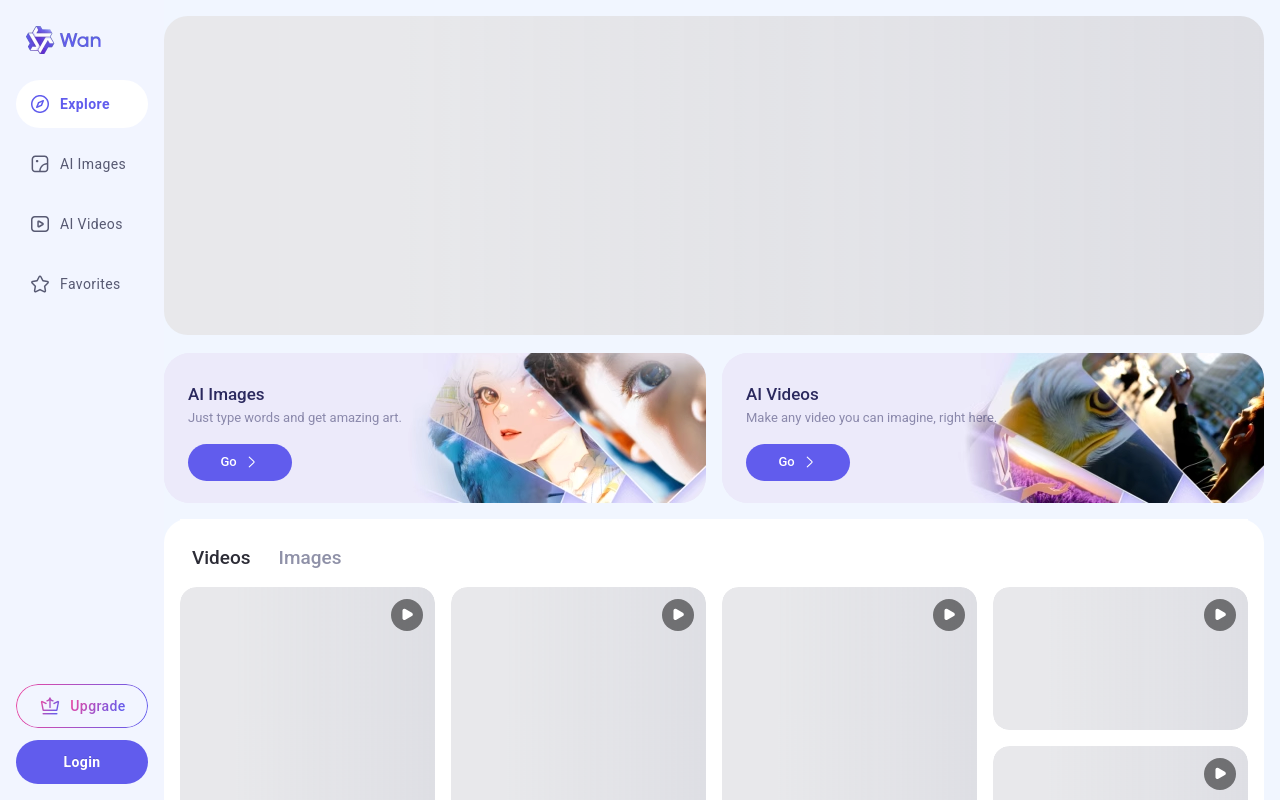

Wan AI 是什么?

访问 https://wan.video,你会进入一个由阿里巴巴 Wan AI 团队打造的创意工坊。它的核心很简单:用文字或图片,让 AI 帮你生成视频。无论是让一张静态的猫图动起来,还是凭空想象一段故事短片,这个平台都能试试看。

它能做什么?

Wan AI 的功能围绕“生成”展开,把想法变成动态画面。

用文字生成视频

输入一段描述,比如“两只拟人化的猫在拳击台上对决”,选择好分辨率和时长,AI 就会开始工作。它的 Wan 2.1 模型有个特别之处:生成视频里的中英文字幕效果很清晰,这对需要带字幕的内容很友好。

让图片动起来

上传一张照片,再告诉 AI 你想让它怎么动。比如给一张风景照加上“风吹麦浪”的效果,它就能生成一段短视频。你可以选择不同的画面比例,适配手机竖屏或是电脑横屏。

AI 视频编辑

除了生成,还能修改。平台提供了一些编辑工具,比如保持视频里人物姿态不变只换背景,或者修复视频中缺失的片段。这些功能更偏向专业一点的后期处理。

其他实用工具

平台还尝试了一些有趣的功能,比如根据视频内容自动配上背景音乐,或者你只提供视频的开头和结尾,让 AI 自动补全中间的过程。这些功能还在完善中。

技术上有何不同?

Wan AI 的底气来自其开源的 Wan 2.1 系列模型。

两种模型,丰俭由人

它提供了两种选择:轻量版的 1.3B 参数模型,用一块像 RTX 4090 这样的消费级显卡就能跑起来,生成一段短视频大概需要几分钟;专业版的 14B 参数模型,效果更强,适合追求高分辨率(720p或1080p)和复杂场景的用户,不过对硬件要求也更高。

完全开源,欢迎折腾

模型代码和权重都在 GitHub 和 Hugging Face 上公开。这意味着开发者可以下载到自己的电脑上运行,也可以基于它进行二次开发。社区里已经出现了不少衍生工具,比如专门做人物动画的版本,或者能优化显存占用的插件。

对硬件比较友好

轻量模型降低了玩 AI 视频的门槛。通过一些优化技术,比如 FP8 量化,还能进一步提升生成速度。

谁会用得上它?

内容创作者和营销人员: 快速生产短视频内容,用于社交媒体或广告。

设计师和视频制作人: 作为创意辅助工具,生成素材或进行概念预览。

开发者和研究者: 开源模型是学习和实验的好材料,也可以集成到自己的应用里。

如何开始使用?

最简单的方法是直接访问官网,用阿里云账号登录即可在线体验大部分功能。

对于开发者,可以去 GitHub 下载模型和代码,在本地部署。官方提供了详细的配置指南,从消费级显卡到多卡专业配置都有对应方案。社区也贡献了像 ComfyUI 这样的图形化工作流工具,让本地运行变得更直观。