如果你既想体验本地大模型推理,又不想被Python生态和GPU依赖绑住手脚,llama.go 是一个值得关注的选项。它用纯 Go 语言重写了 LLaMA 推理核心,无需 CUDA、PyTorch 或任何 Python 运行时,就能在 CPU 上加载并运行量化后的 LLaMA 系列模型,非常适合 Go 技术栈的开发者快速集成或二次开发。

核心看点

– 纯 Go 实现,零外部依赖:整个推理引擎仅依赖 Go 标准库和少量 C 代码(用于 mmap),编译后单二进制即可运行,部署极其轻量。

– 支持主流量化格式:可直接加载 GGUF 格式的量化模型(如 q4_0、q8_0),与 llama.cpp 生态兼容,无需额外转换工具。

– 交互式与 API 双模式:既提供命令行对话界面,也内置了兼容 OpenAI API 的 HTTP 服务端,方便接入已有应用。

适合谁

– Go 语言开发者:想在项目中嵌入本地推理能力,无需引入 Python 子进程或复杂环境。

– 边缘设备与资源受限场景:没有 GPU,但需要离线运行中小型模型(如 7B 参数量级)的推理任务。

– 学习推理原理的研究者:Go 代码结构清晰,适合阅读 LLaMA 推理的前向传播和 KV Cache 实现细节。

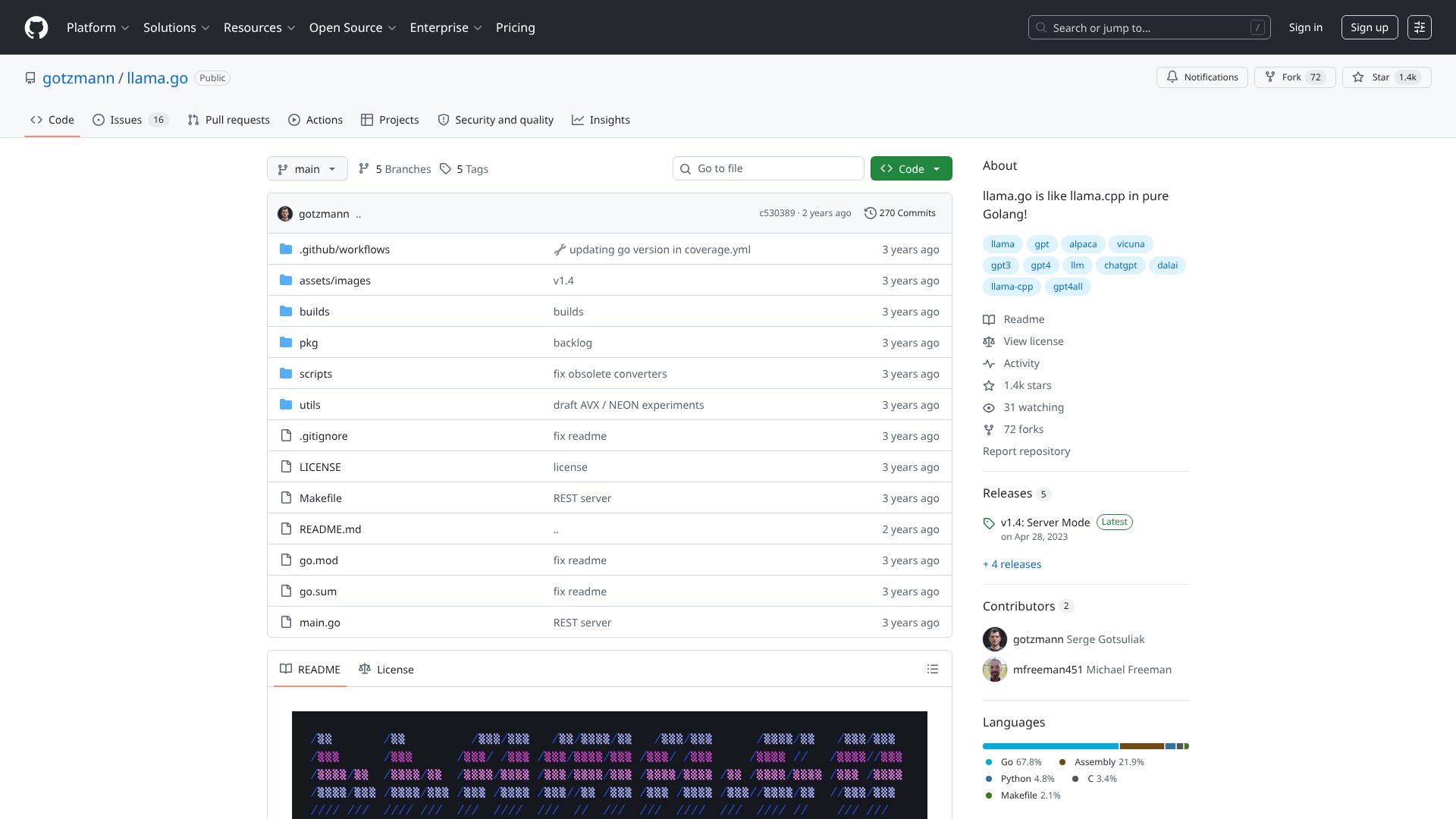

如果你手头刚好有一台 CPU 机器,或者想探索 Go 在 AI 推理侧的潜力,不妨到 llama.go 仓库主页 下载 release 二进制试试看。项目采用 MIT 许可证,社区活跃度尚可,Issues 里也有不少实用的配置讨论。