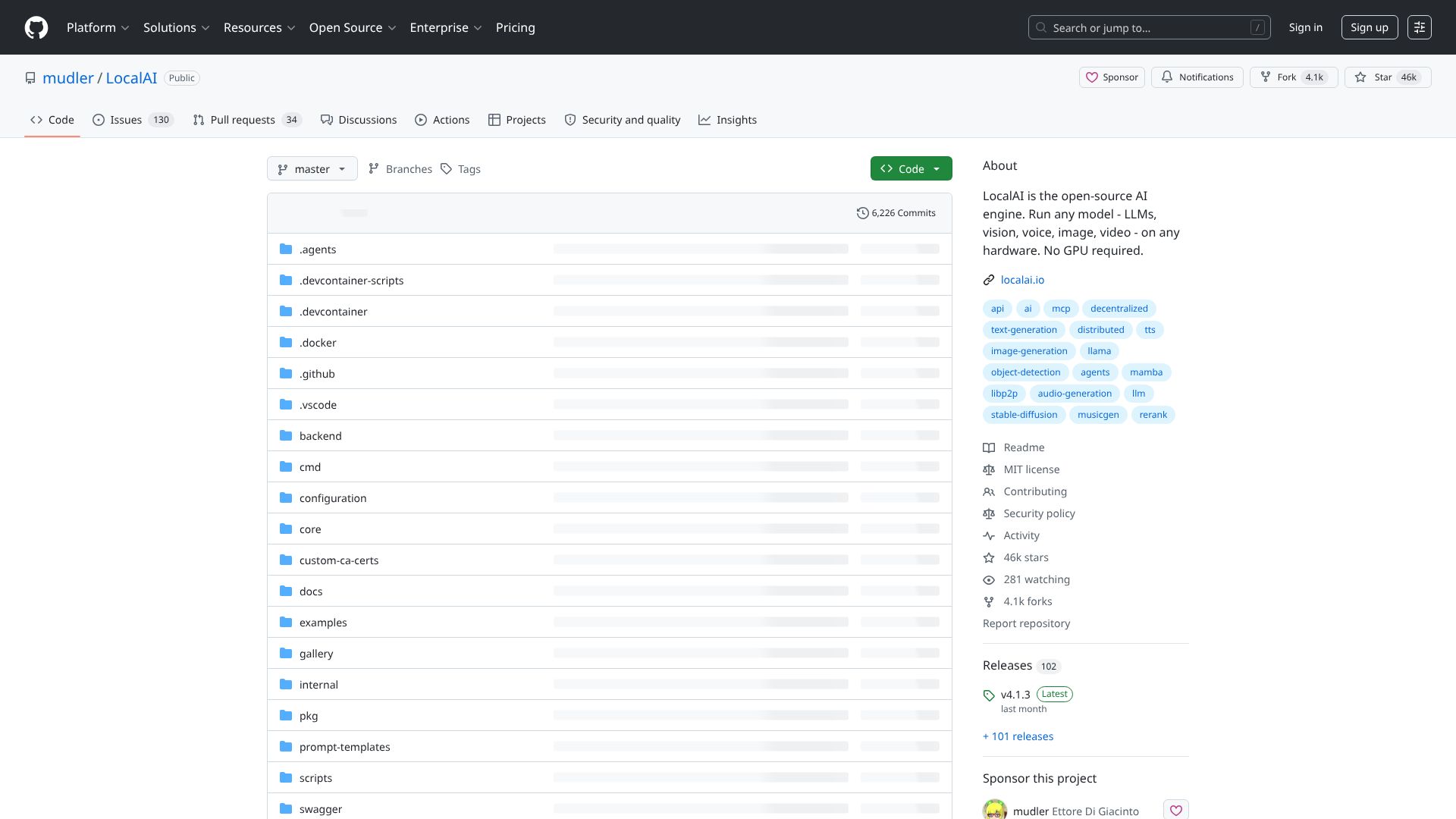

LocalAI 是一个开源的自托管 AI 推理服务器,让你无需 GPU 或云端 API 就能在本地 CPU/GPU 上运行 LLM、图像生成、语音识别等多模态模型。它兼容 OpenAI API 格式,可直接替换现有应用的后端,特别适合注重数据隐私、离线场景或想低成本尝试 AI 能力的开发者与研究者。

核心看点

– 多模态支持:不仅支持 Llama、Mistral 等大语言模型,还集成了 Stable Diffusion 文生图、Whisper 语音转文字、TTS 语音合成,甚至支持 Reranker 和 Embedding 模型,一套服务覆盖多种推理需求。

– 无 GPU 也能跑:通过 llama.cpp 和 whisper.cpp 等后端,在纯 CPU 上即可运行量化模型(如 GGUF 格式),同时也可利用 CUDA、Vulkan 等加速,灵活适配不同硬件。

– OpenAI API 兼容:提供与 OpenAI 几乎一致的 REST API 接口,原有客户端代码几乎零修改即可指向本地 LocalAI 实例,方便从 SaaS 迁移到本地或进行混合部署。

上手提示

适合隐私敏感的企业内部知识库、离线环境下的个人助手、或想低成本尝试多种 AI 模型的学生与开发者。依赖 Docker 或 Go 环境,无需 GPU 也能运行,但若需加速建议配备至少 8GB 内存的 CPU 或低端 GPU。无需任何 API Key,所有推理都在本地完成;模型权重需自行下载,仓库 README 提供详细的一键启动脚本和示例。

最后,如果你正寻找一个能统一管理 LLM、图像、语音推理的本地方案,不妨看看 LocalAI 的快速入门指南和预置模型列表,或许正是你需要的那个“瑞士军刀”。点此访问 LocalAI GitHub 仓库