厌倦了配置复杂的推理环境?Ollama 让你像用 Docker 一样,一条命令就能在本地拉起 Llama 3、Qwen2、Mistral 等主流开源模型。无论是 Mac、Linux 还是 Windows,安装后即可通过 REST API 或终端交互,特别适合需要离线调试、隐私优先或快速原型验证的开发者。

核心看点

– 极简部署体验:ollama run llama3.2 即可下载并运行模型,自动处理量化、依赖和端口映射,无需手动配置 Python 或 CUDA。

– 丰富的模型库:内置数百个预配置模型,覆盖 7B 到 70B 参数规模,支持 GGUF 格式自定义导入,且社区持续贡献新模型。

– API 与生态兼容:提供 OpenAI 兼容的 /v1/chat/completions 接口,可直接对接 LangChain、Continue、Open WebUI 等工具,本地开发无缝切换。

适合谁

– 个人开发者:快速测试不同模型效果,或构建本地 AI 助手。

– 隐私敏感场景:医疗、金融等数据不出本地的推理需求。

– 边缘设备玩家:通过量化模型在 8GB 内存的 MacBook 上流畅运行 7B 参数模型。无需 GPU,CPU 也能跑,但推荐至少 16GB 内存。

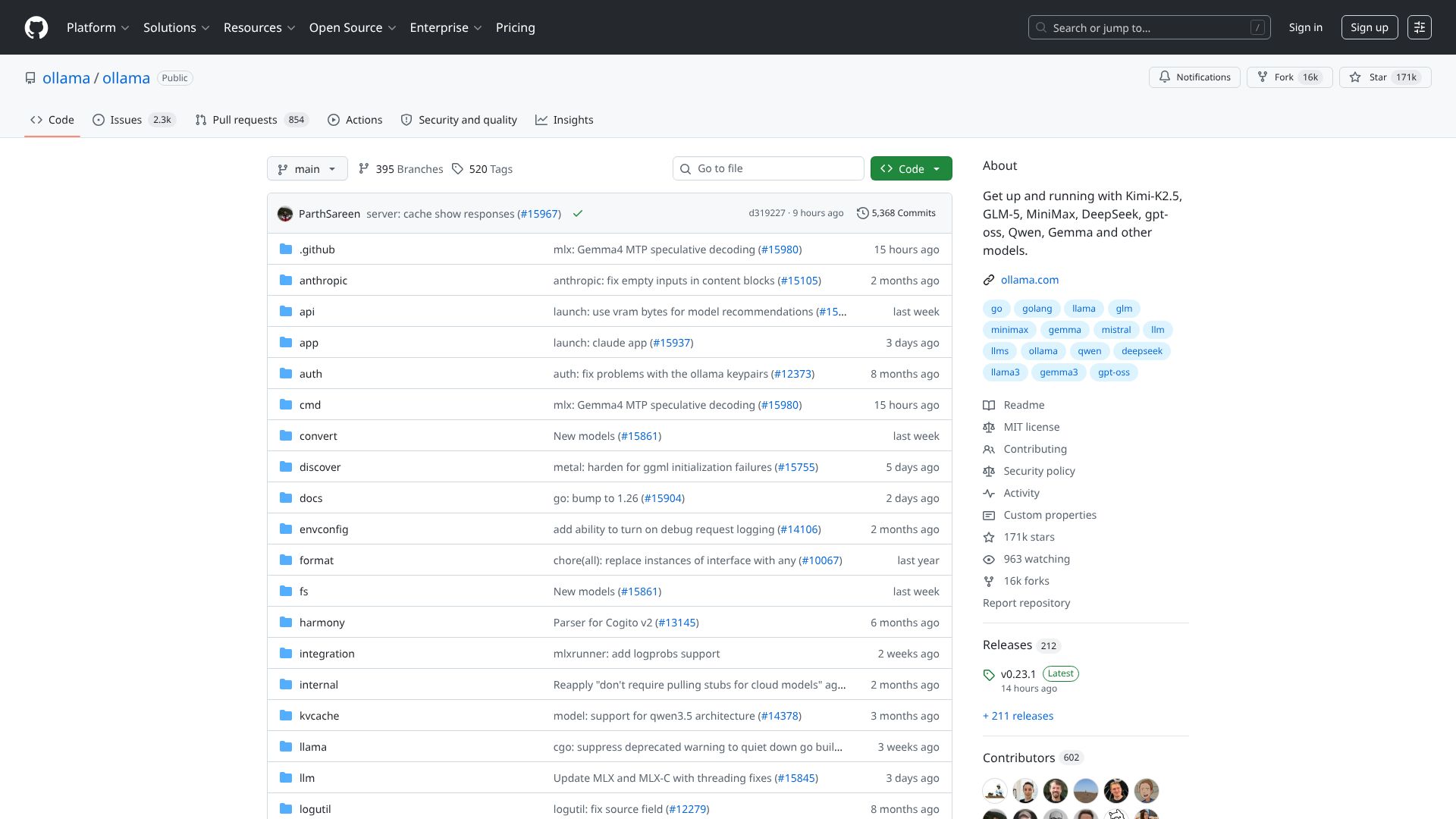

Ollama 的 README 清晰列出了所有命令和模型标签,如果你想了解如何自定义 Modelfile 或接入外部工具,直接去仓库看 Ollama 官方仓库 的文档和 Discussions,社区里有很多实用技巧。