快速了解:MMLU

是什么:多任务语言理解基准评测

适合

关注 大模型、大模型评测 相关场景的用户;主要在 全球用户 下使用 AI 工具的用户

注意

若你期望完全离线、私有化部署且不接受任何联网服务,请优先评估企业版或自建方案。

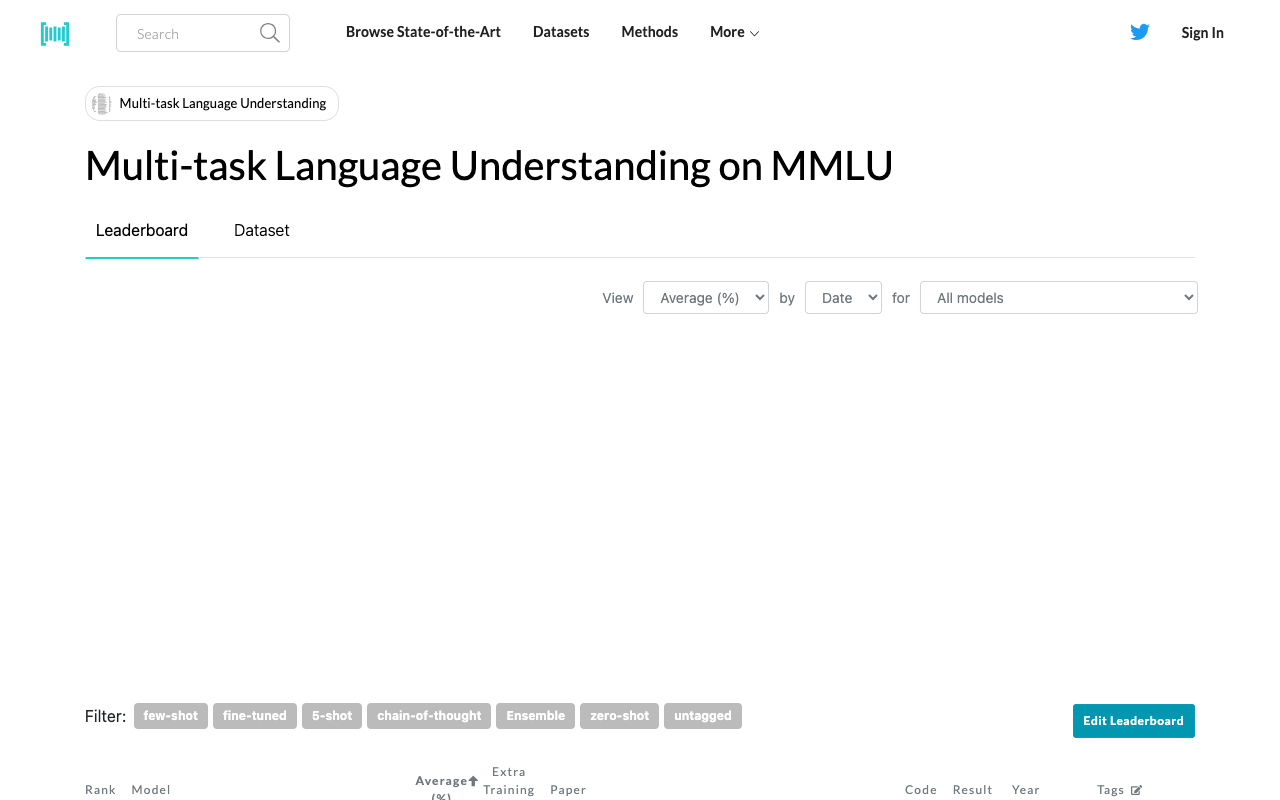

在Papers with Code网站上,有一个专门追踪MMLU基准测试最新进展的页面。这个页面就像语言模型界的“成绩单排行榜”,实时展示哪些模型在应对多学科知识问答时表现最出色。

MMLU数据集:考考AI的“通识”

MMLU的全称是“大规模多任务语言理解”。它的任务很简单:做选择题。但题目范围极广,覆盖57个不同领域,从高中数理化到大学的人文社科,甚至法律、医学等专业内容都有涉及。目的就是检验一个语言模型的知识广度和理解深度,最终以准确率来评分。

排行榜上看什么?

打开这个排行榜页面,你主要能看到以下几块内容:

核心排名:所有模型按总准确率从高到低排列。排在前面的,比如可能是GPT-4、LLaMA等知名模型。

详细信息:点击每个模型,通常能看到它的总得分、关键子领域的得分、对应的研究论文链接,以及如果开源的话,其代码仓库地址。

动态更新:这个榜单是活的。只要有新模型发布或新论文出炉,榜单就会更新,确保你看到的是最前沿的战况。

谁会用这个页面?

研究人员用它来快速了解领域现状,寻找下一个研究方向。开发者可以在这里发现优秀的开源模型,直接获取代码。学生或爱好者也能通过它直观感受当前AI的语言理解能力到底到了什么水平。

总之,如果你想快速知道“现在哪个语言模型最博学”,这个MMLU排行榜是个很直接的参考。访问链接就能看到这份不断更新的成绩单,对比各模型长短,并直达背后的论文和代码。