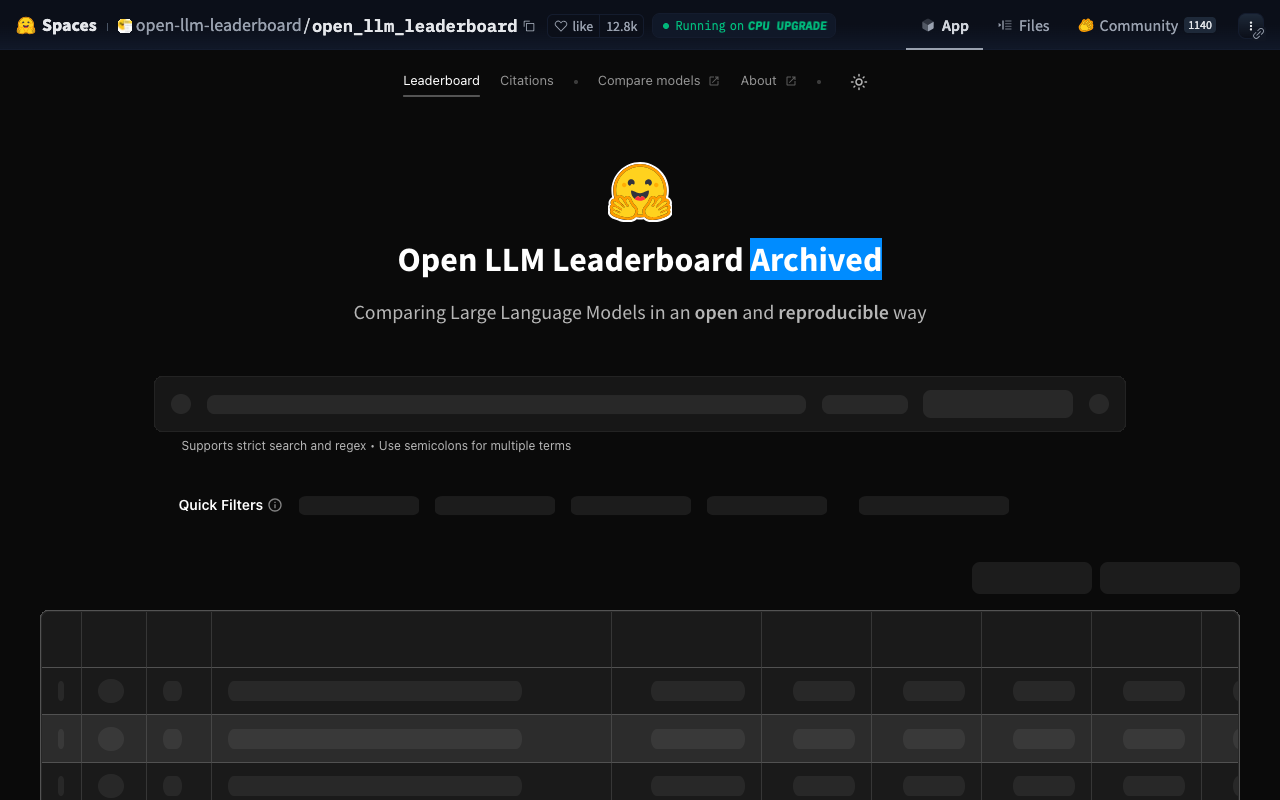

想在一堆开源大语言模型里挑个厉害的,又怕宣传有水分?Hugging Face上的Open LLM Leaderboard(开放大语言模型排行榜)就是干这个的。它像个公正的裁判,用一套标准化的考题(比如MMLU、HellaSwag这些基准测试),给各路模型打分排名,让你能一眼看出谁是真学霸。

主要用途

这个排行榜的核心目标很简单:让模型比较变得公平、透明。不同团队自说自话的测试结果在这里被统一规整,所有模型都在相同的条件下答题。这为机器学习社区的研究者、开发者和好奇用户提供了一个可靠的参考系。

核心功能

模型排名与评估

网站最显眼的就是那个排行榜,上面列着各种开源模型的性能得分。每个模型都要经历同样的“期末考试”,成绩单上会清楚显示它在不同科目(比如多选题、推理题)上的表现。

可重现性支持

它不只给结果,还把“阅卷”过程公开了。如果你不信服,完全可以按照它提供的代码和工具(比如Eleuther AI的LM Evaluation Harness),自己动手把分数再算一遍。

模型详情与社区

点击模型旁边的图标,你能看到更详细的信息,比如规模、具体的输入输出例子。如果某个模型被社区打了“小报告”(Flagged),也能看到相关讨论。你甚至可以把自己的模型送来“参赛”,提交后会自动加入测试队列。

数据与历史

所有的评估结果都作为公开数据集存放在Hugging Face上,供任何人下载分析。这个排行榜自推出以来,已经记录了超过13,000个模型的“成绩档案”,见证了开源LLM领域的飞速发展。

现状与遗产

需要注意的是,这个功勋卓著的排行榜已于2025年3月28日正式退役。团队认为,随着模型能力重点转向多模态、长上下文推理等新领域,旧的测试标准已经有些跟不上时代了,为了避免误导大家继续“刷旧题”,他们选择了让榜单退休。不过,所有的历史数据依然开放访问,它推动评估标准化的努力,也为后来的接任者打下了坚实的基础。